时间:2024-03-13|浏览:262

近日,NEAR创始人@ilblackdragon将亮相英伟达AI大会的消息,让NEAR公链赚足了眼球,市场价格走势也喜人。 网友疑惑,NEAR链不是All in在做链抽象么,怎么莫名其妙就成了AI头部公链了?接下来,分享下我的观察,顺带科普下一些AI模型训练知识:

1)NEAR创始人Illia Polosukhin拥有过宝贵时间的AI背景,是Transformer架构的共同构建者。而Transformer架构是如今LLM大型语言模型训练ChatGPT的架构基础,证明NEAR老板在成立之前NEAR确实有AI大型模型系统的创建和领导经验。

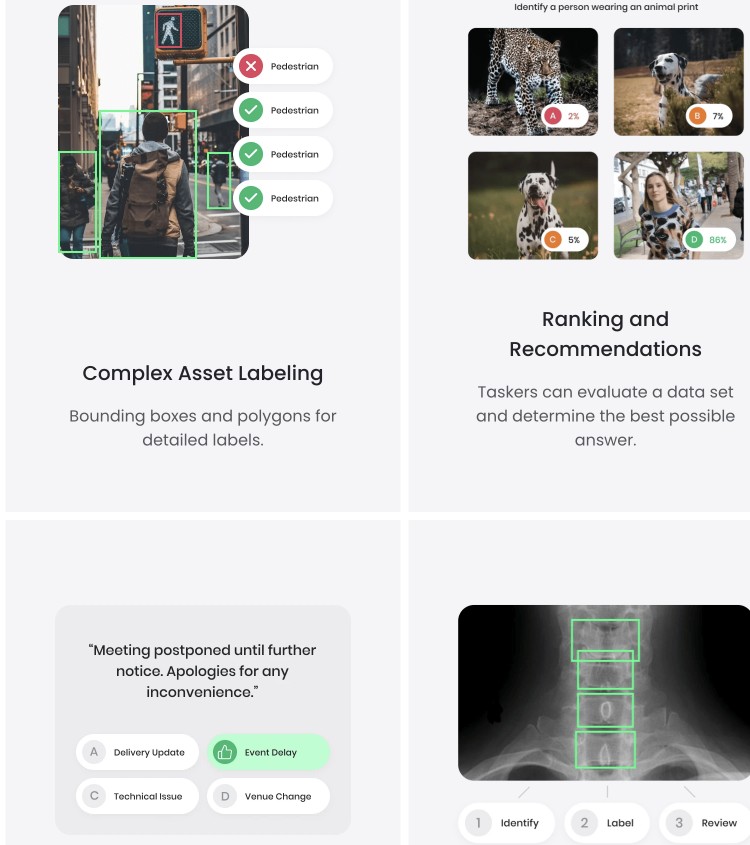

2)NRAR 曾在 NEARCON 2023 上推出过 NEAR Tasks,目标是为了进行人工智能模型的训练和改进,简单来说,模型训练需求方(Vendor)可以在平台发布任务请求,并基础上传数据素材,用户(Tasker)可以参与进行任务答题,为数据进行文字标记和图像识别等人工操作。任务完成后,平台会给用户NEAR代币奖励,而这些经过人工标记的数据会被用于训练相应的AI模型。

例如:AI模型需要提高识别图片中物体的能力,供应商可以将大量图片中带有不同物体的原始图片上传到任务平台,然后用户手动标注图片上物体位置,就可以生成大量“图片-物体位置” ”的数据,AI就可以利用这些来自主学习的数据来提高图片识别能力。

乍一听,NEAR Tasks不就是想社会化人工工程来为AI模型做基础服务嘛,真有那么重要吗?这里加一点关于AI模型的科普知识。

通常情况下,一次完整的AI模型训练,包括数据采集、数据标注和标注、模型设计与训练、模型调优、调整、模型验证测试、模型部署、模型监控与更新等过程,其中数据标注和重建为人工部分,而模型与优化为机器部分。

显然,大多数人理解的机器部分要明显大于人工部分,毕竟视野更高科技一些,但实际情况下,人工标注在整个模型训练中至关重要。

人工标注可以为图像中的对象(人、地点、事物)等添加标签,供计算机视觉提升模型学习;人工标注还可将语音中的内容转化为文本,并标注特定音节、单词单词等帮助计算机进行语音识别模型训练;人工标注还可以给文本添加一些快乐、悲伤、愤怒等情感标签,让人工智能增强情感分析技能等等。

不难看出,人工标记是机器开展深度学习模型的基础,没有高质量的高效标记数据,模型就无法学习,如果标记数据量不够大,模型成绩会获得提高。

目前,AI微创领域有很多基于ChatGPT大模型进行二次校准或针对性的垂直方向,本质上都是在OpenAI的数据基础上,另外增加新的数据源尤其是人工标注数据来施展模型训练。

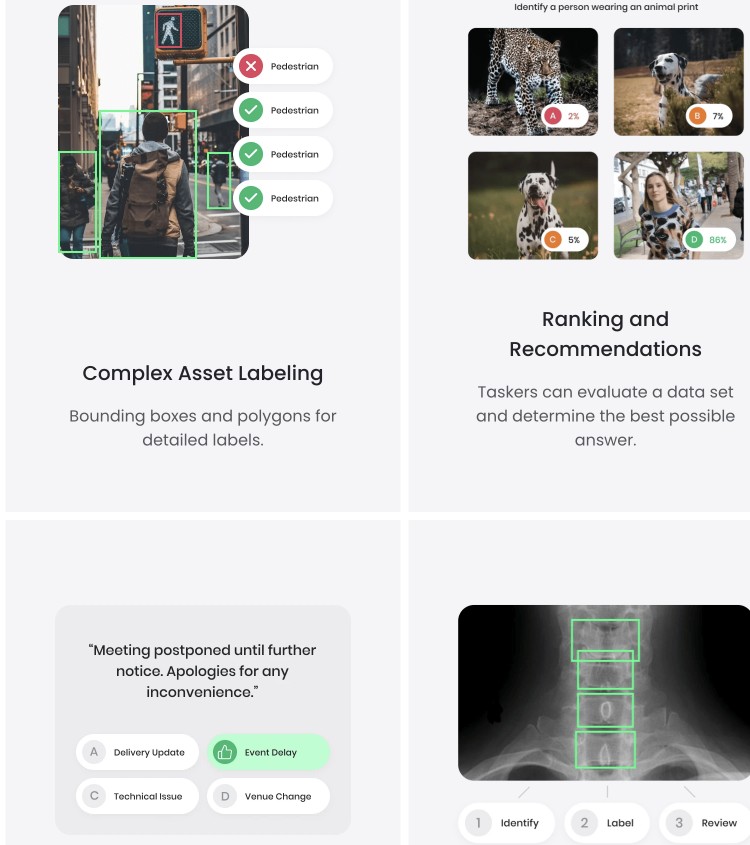

比如,医疗公司想基于医学影像AI做模型训练,为医院提供一套在线AI问诊服务,只需要将大量的原始医学影像数据上传到任务平台,然后让用户去标注并完成任务,就产生了人工标注数据,再将这些数据对ChatGPT大模型进行偏差和优化,一定会让这个通用AI工具变成垂直领域的专家。

,NEAR 简单依靠任务平台,就想成为 AI 公链龙头显然还不够,NEAR 其实还在生态系统中进行 AI 代理服务,用来自动执行用户一切链上行为和操作不过,用户只需授权就可以自由在市场中买卖资产。这有点类似以意图为中心,用AI自动化来提升用户链上体验交互。除此之外,NEAR强大的DA能力可以增强在AI数据来源的可追溯性上发挥作用,追踪AI模型训练数据有效性和真实性。

总之,背靠高性能的链功能,近乎做AI方向的技术延展和叙述引导,似乎单纯的链抽象要隐形觉厉多了。

半个月我在分析NRAR链抽象时,就看到了近链性能+团队超强的web2资源整合能力的优势,万万没想到,链抽象还没有普及开来摘到果子,这波AI赋能再一次把想象力放大了。

注:长期关注还是得看NEAR在“链抽象”上的布局和产品推进,AI会是个不错的加分项和牛市催化剂!#NEAR

![[财富密码]英伟达AI大会正在进行,盘点加密领域受益的相关标的](/img/btc/93.jpeg)

![[财富密码]英伟达AI大会正在进行,盘点加密领域受益的相关标的](/img/btc/96.jpeg)